Czy wiesz, że za spadkiem wydajności Twojego sklepu internetowego wcale nie muszą stać prawdziwi klienci, ani źle zoptymalizowany kod? Czasem cichym zabójcą serwera są boty. Jako zespół Diggi.pl na co dzień dbamy o to, by strony i sklepy naszych klientów działały błyskawicznie. 1 grudnia 2025 roku przeprowadzaliśmy standardową optymalizację i audyt wydajnościowy dla zaprzyjaźnionego sklepu swizzer.pl. Analiza wykazała permanentne przeciążenie serwera – zużycie procesora (CPU) regularnie dobijało do 100%. To, co odkryliśmy w logach serwera, mocno nas zaskoczyło.

Cichy morderca wydajności: Boty w koszyku

Pierwsza myśl przy wysokim zużyciu CPU? „Mamy duży ruch, sklep świetnie sprzedaje!”. Niestety, prawda okazała się zupełnie inna. Ruch rzeczywiście był gigantyczny, ale generowały go maszyny.

Standardowe zachowanie botów (np. Googlebot) polega na „czytaniu” strony w celu jej zaindeksowania. To generuje lekki ruch, który z reguły obsługiwany jest przez systemy cache (pamięć podręczną). Jednak w przypadku swizzer.pl mieliśmy do czynienia z nową generacją agresywnych scraperów (m.in. botów zbierających dane dla AI).

Te boty nie tylko przeglądały ofertę, ale wykonywały zaawansowane, ciężkie operacje:

- Dodawały i usuwały produkty z koszyka.

- Manipulowały listami życzeń (wishlist).

- Przechodziły na strony logowania i mojego konta.

Dlaczego to taki problem? Każda akcja typu ?add-to-cart= bezpowrotnie omija cache. Zmusza serwer do wygenerowania nowej sesji dla użytkownika (bota) i wykonania ciężkich zapytań do bazy danych. Kiedy setki botów jednocześnie dodają produkty do koszyka, nawet najpotężniejszy hosting zaczyna „klękać”.

Rozwiązanie: Jak odcięliśmy botom tlen?

Postanowiliśmy zadziałać u podstaw i zablokować botom dostęp do dynamicznych, niekeszowanych ścieżek sklepu za pomocą pliku robots.txt.

Oto gotowy kod, który wdrożyliśmy. Możesz (i powinieneś!) skopiować go do swojego sklepu na WooCommerce:

Plaintext

# Blokada ciężkich akcji WooCommerce dla wszystkich botów

User-agent: *

Disallow: /koszyk/

Disallow: /lista-zyczen/

Disallow: /moje-konto/

Disallow: /*add-to-cart=

Disallow: /*add-to-wishlist=

Disallow: /*remove_item=

# Całkowita blokada bota Claude (agresywne zbieranie danych dla AI)

User-agent: ClaudeBot

Disallow: /

# Całkowita blokada BLEXBot (często obciąża serwery, jeśli nie używasz narzędzia SE Ranking)

User-agent: BLEXBot

Disallow: /

Efekt? Sklep wraca do życia

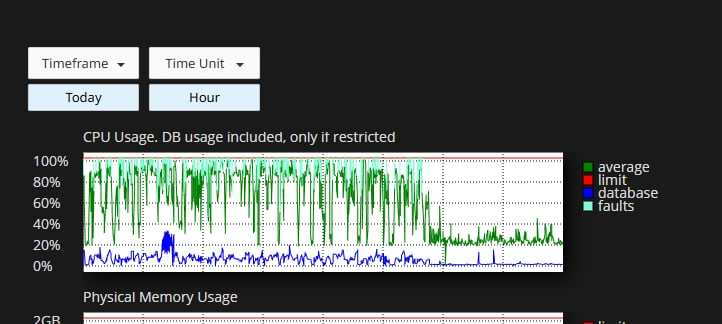

Spojrzyjcie na poniższy wykres zużycia zasobów

Zielona linia, oznaczająca średnie zużycie procesora, utrzymywała się na krytycznym poziomie niemal 100%, powodując opóźnienia w ładowaniu strony dla prawdziwych klientów. Moment drastycznego spadku do poziomu poniżej 20-30% to właśnie chwila wdrożenia naszego pliku robots.txt. Sklep odetchnął z ulgą, a my przywróciliśmy stabilność bez konieczności kosztownego przechodzenia na wyższy pakiet hostingowy.

Podsumowanie od Diggi.pl

Zabezpieczenie pliku robots.txt to pierwszy i najważniejszy krok w higienie każdego sklepu WooCommerce. Pamiętaj jednak, że złośliwe boty hakerskie często ignorują ten plik. Jeśli problem powraca, w Diggi wdrażamy dodatkowe zabezpieczenia, takie jak reguły WAF (Web Application Firewall) na poziomie serwera lub Cloudflare.

Masz wrażenie, że Twój sklep działa wolniej niż zazwyczaj, a hosting wysyła powiadomienia o limitach CPU? Skontaktuj się z nami na diggi.pl – zajrzymy pod maskę Twojego WordPressa i zrobimy z nim porządek!